Abstract (초록)

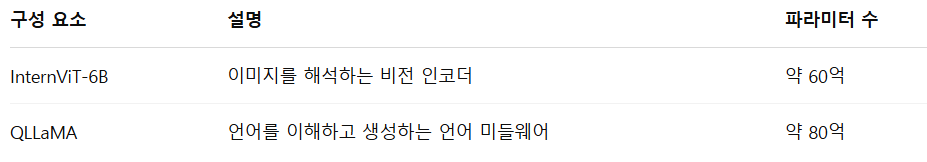

InternVL은 60억 개의 파라미터를 가진 비전 인코더(이미지를 다루는 부분)와 80억 개의 파라미터를 가진 언어 미들웨어(언어를 다루는 부분)로 구성된 대규모 vision-language foundation 모델이다.

이 모델은 웹에서 수집한 방대한 양의 이미지와 텍스트 데이터를 점진적으로 정렬하며 학습함으로써, 다양한 그림-글 관련 작업에서 성능과 효율을 극대화한 바 있으며 챗봇처럼 사람과 대화하는 기능에서도 뛰어난 성능을 보인다. 또 여러 그림-글 처리 작업에 유연하게 활용될 수 있는 구조를 가지고 있고 특히 다국어 언어 모델(LLaMA)을 언어 미들웨어 초기값으로 활용함으로써, 그림을 보는 능력과 말을 이해하는 능력 사이의 균형을 맞추고 표현 간 일관성을 확보했다는 장점이 있다.

1. Introduction (소개)

- 비전 및 비전-언어 파운데이션 모델의 발전은 LLM에 비해 상대적으로 느리다 . InternVL은 이를 해소하고자 대규모 비전-언어 파운데이션 모델을 설계하고, 웹 규모의 이미지-텍스트 데이터를 사용하여 LLM과 점진적으로 정렬한다. 또한 이미지 수준 또는 픽셀 수준 인식, 비전-언어 작업(예: 제로샷 이미지/비디오 분류, 제로샷 이미지/비디오-텍스트 검색)과 같은 32개의 일반적인 시각-언어 벤치마크에서 최첨단 성능을 달성했다.

- 기존 VLLM은 비전 모델과 LLM을 연결하기 위해 QFormer 또는 선형 투영과 같은 경량 "glue" 레이어를 사용하지만, 이는 파라미터 규모 불일치, 표현 불일치, 비효율적인 연결 등의 문제점에 부딪혔다 . InternVL은 성능을 떠나 인코더를 LLM의 파라미터 규모에 맞춰 확장하고, 표현을 조화시키는 데 중점을 두어 해결하고자 하였다는 점에서 의미가 있는 모델이다.

2. Related Work (관련 연구)

2.1. Vision Foundation Models (비전 파운데이션 모델)

기존의 그림 인식 인공지능 모델은 CNN(AlexNet 등)에서 시작하여, 네트워크가 깊어짐에 따라 성능이 향상되어 왔다. 특히 ResNet의 도입은 학습 안정성을 높였고, 이후 Transformer 구조(ViT)의 등장은 이미지 처리 방식에 큰 변화를 가져왔다.

그러나 이러한 모델들은 이미지 전용 데이터셋(ImageNet 등)으로만 학습되어 언어와 자연스럽게 연결되지 못하는 한계가 있었다.

2.2. Large Language Models (대규모 언어 모델)

GPT-3 이후, 인간처럼 글을 이해하고 생성하는 모델들이 등장했으며, 적은 예시만으로도 다양한 작업을 수행할 수 있게 되었다. 현재는 ChatGPT, GPT-4의 발전에 따라, LLaMA, Vicuna 같은 오픈소스 언어 모델들도 활발히 개발되고 있다.

2.3. Vision Large Language Models (비전 대규모 언어 모델)

Flamingo, GPT-4, LLaVA 등은 그림을 이해하고 그에 대한 설명이나 질문 응답을 수행할 수 있다. 특히 시각적 명령어 튜닝(instruction tuning)이라는 학습 기법을 통해, 실제 사용 환경에서의 응답 정확도를 높이고 있다.

3. Proposed Method (제안 방법)

3.1. Overall Architecture (전체 아키텍처)

상술했듯 본 모델은 크게 비전 인코더와 QLLaMA라는 언어 미들웨어로 구성되어 있다.

이 두 모델은 서로 규모가 맞지 않아 잘 연결되지 않는 기존의 문제를 극복하기 위해, 점진적으로 정렬해 나가는 훈련 전략을 사용했다.

3.2. Model Design (모델 설계)

- InternViT-6B는 비전 인코더로, 기존보다 훨씬 더 많은 파라미터를 사용하여 성능을 강화함. 정확도, 속도, 안정성을 균형 있게 유지하기 위해 하이퍼파라미터 튜닝을 실시

- QLLaMA는 언어 미들웨어로, 기존의 다국어 LLaMA를 기반으로 하되, 이미지와 언어 간 정렬을 위한 추가 구조(96개의 학습 가능한 쿼리, cross-attention layer)를 탑재

3.3. Alignment Strategy (정렬 전략)

InternVL의 훈련은 시각-언어 대조 훈련, 시각-언어 생성 훈련 및 지도 fine-tuning을 포함하는 세 가지 단계로 구성된다.

1) 대조 학습 (Contrastive Training)

→ 대량의 이미지-텍스트 쌍을 바탕으로, 이미지와 설명이 서로 잘 어울리는지를 학습함.

2) 생성 훈련 (Generative Training)

→ 이미지를 보고 그에 맞는 문장을 직접 생성해보는 훈련을 수행함.

3) 지도 학습 (Supervised Fine-tuning)

→ 실제 대화나 응용 사례에 맞춰 더 정교하게 조정함.

4. Experiments (실험)

4.1. Implementation Details (구현 세부 사항)

각 단계별 초기값 설정, 하이퍼파라미터 조정 등 학습 전략에 대한 자세한 설명이 포함됨

4.2. Visual Perception Benchmarks (시각적 인식 벤치마크)

- Transfer to Image Classification: ImageNet-1K 데이터 세트를 사용하여 InternViT-6B에서 생성된 시각적 표현의 품질을 평가(인식 능력 평가)

- Transfer to Semantic Segmentation: ADE20K 데이터 세트에서 시맨틱 분할에 대한 광범위한 실험을 수행하여 InternViT-6B의 픽셀 수준 인식 능력을 측정(즉, 이미지 속 객체 영역을 얼마나 정확하게 구분하는지 측정)

4.3. Vision-Language Benchmarks (비전-언어 벤치마크)

- Zero-Shot Image Classification: InternVL의 제로샷 이미지 분류 기능을 검증

- Zero-Shot Video Classification: Kinetics-400/600/700에서 top-1 정확도 및 평균 top-1 및 top-5 정확도를 측정

- Zero-Shot Image-Text Retrieval: InternVL의 강력한 다국어 이미지-텍스트 검색 기능을 평가.

- Zero-Shot Image Captioning: QLLaMA는 대규모 고품질 이미지-텍스트 쌍에 대한 비전-언어 생성 훈련의 이점을 통해 제로샷 이미지 캡션 생성 능력을 확인

4.4. Multi-Modal Dialogue Benchmarks (다중 모달 대화 벤치마크-그림 기반 대화 실험)

멀티모달 챗봇 환경에서도, InternVL은 실제 사용자 시나리오에 적합한 응답을 생성

4.5. Ablation Study (절제 연구)

InternViT-6B의 하이퍼파라미터에 대한 다양한 변형을 실험하여, 어떤 요소가 성능에 중요한지를 분석함.

5. Conclusion (결론)

InternVL은 60억 파라미터의 비전 인코더와 80억 파라미터의 언어 미들웨어를 정렬하여 만든 대규모 그림-글 AI 모델로 기존 모델들이 가진 연결의 비효율성과 표현 불일치를 해결하고, 다양한 이미지 및 영상 인식, 설명, 검색, 대화 작업을 하나의 모델에서 수행할 수 있음을 입증함.

Novelty (참신성)

- 대규모 비전-언어 모델: 60억 개의 파라미터를 가진 비전 인코더와 80억 개의 파라미터를 가진 언어 미들웨어를 결합하여 모델 규모를 확장

- 점진적 학습 방식: 대조 학습 → 생성 → 지도학습이라는 단계별 학습 전략을 새롭게 제안함

- 다국어 LLaMA 초기화: 다국어 대응이 가능한 언어 모델(LLaMA)을 초기값으로 사용하여 글로벌 활용성을 확보하고 대화의 일관성을 얻음

Contribution (기여도)

- 최첨단 성능: 32개의 일반적인 시각-언어 벤치마크에서 SOTA 기록

- 다양한 작업 지원: 이미지 분류, 비디오 분류, 이미지-텍스트 검색, 이미지 캡셔닝, 시각적 질문 응답 및 멀티모달 대화와 같은 다양한 시각-언어 작업을 지원함

- 효율적인 훈련: 웹 규모의 noisy 이미지-텍스트 데이터를 활용하여 효율적인 훈련을 가능하게 함

- LLM과의 호환성: 기존 LLM과의 통합을 통해 멀티모달 대화(챗봇) 시스템 개발에 기여