논문 제목: SPICE: Self-Play In Corpus Environments

논문 링크: https://arxiv.org/abs/2510.24684

SPICE: Self-Play In Corpus Environments Improves Reasoning

Self-improving systems require environmental interaction for continuous adaptation. We introduce SPICE (Self-Play In Corpus Environments), a reinforcement learning framework where a single model acts in two roles: a Challenger that mines documents from a l

arxiv.org

논문 정보: 25년도 메타 FAIR 팀에서 발표한 논문(인용수 오늘 기준 17회)

초록

자기 개선 시스템은 지속적인 적응을 위해 환경과의 상호작용을 필요로 함

본 논문에서는 SPICE(Self-Play In Corpus Environments)라는 강화 학습 프레임워크를 소개함

SPICE에서는 단일 모델이 두 가지 역할을 수행

하나는 대규모 코퍼스에서 문서를 추출하여 다양한 추론 과제를 생성하는 챌린저(Challenger)이고, 다른 하나는 이러한 과제를 해결하는 추론자(Reasoner)임

적대적 역학을 통해 도전자는 추론자의 능력 한계에 도달하는 자동 커리큘럼을 생성하고, 코퍼스 grounding은 지속적인 개선에 필요한 풍부하고 거의 무한한 외부 신호를 제공

→grounded: 외부 세계/ 데이터에 기반한 것

기존의 ungrounded된 자체 플레이 방식이 제한적인 이점만을 제공하는 것과 달리, SPICE는 다양한 모델 계열에서 수학적 추론(+8.9%) 및 일반 추론(+9.8%) 벤치마크 전반에 걸쳐 일관된 성능 향상을 달성함

→ ungrounded: 외부 데이터 없이 모델 내부에서만 생성

저자의 분석에 따르면 document grounding은 SPICE가 지속적으로 더욱 어려운 목표를 설정하고 달성하여 지속적인 자기 개선을 가능하게 하는 핵심 요소임

소개

자기 개선형(Self-Improving) 인공지능(Schmidhuber, 2007; Clune, 2019)은 시스템이 환경과의 상호작용 및 지속적인 적응을 통해 자율적으로 능력을 향상시키는 인공 일반 지능(AGI)으로 가는 하나의 경로로 오랫동안 구상되어 옴

이러한 비전은 대규모 언어 모델(LLM; Kaplan et al. (2020); Achiam et al. (2023); Dubey et al. (2024))을 통해 구체화되고 있으며, 이러한 모델들은 다양한 영역에서 놀라운 추론 능력을 보여주고 있음(CoT; Zero-shot; Few-shot)

최근의 획기적인 연구 결과는 강화 학습이 더욱 정교한 추론을 가능하게 한다는 것을 보여줌

OpenAI o1(OpenAI, 2024) 및 DeepSeek-R1(DeepSeek Team, 2024)과 같은 모델은 검증 가능한 보상을 사용하는 강화 학습(RLVR)을 통해 수학 및 코딩 작업에서 전문가 수준의 성능을 달성

인간의 감독 없이 이러한 기능을 확장하기 위해, 자체 경쟁(self-play)은 유망한 패러다임을 제공(Silver et al., 2017; Sukhbaatar et al., 2017)

자체 경쟁(self-play)에서 모델은 스스로 경쟁하고 경쟁을 통해 자동 피드백을 생성함으로써 성능을 향상시킴

그러나 기존의 언어 모델용 자체 학습(self-play) 방식은 대부분 초기에는 개선을 보이지만 곧 근본적인 한계에 직면

외부 grounding이 없으면 모델은 필연적으로 정체되거나 붕괴됨(Huang et al., 2025; Chen et al., 2025b; Kuba et al., 2025)

이는 두 가지 중요한 문제 때문임

- 환각 증폭: 생성된 질문과 답변 모두에서 사실 오류가 누적되는 현상으로, 모델이 검증 불가능한 자체 합성 데이터로 학습함에 따라 발생

- 정보 대칭성: 문제 생성자와 해결자가 동일한 지식 기반을 공유하는 경우, 진정한 도전이 불가능해지고 더 단순하고 반복적인 패턴이 나타남

변분 합성(variational synthesis)을 통해 다양성을 유지하는 접근 방식(Liang et al., 2025)조차도 궁극적으로는 초기 적용 범위의 한계에 부딪히게 되는데, 이는 단지 원래 사전 학습 데이터의 압축된 표현일 뿐임(Morris et al., 2025)

이러한 체계적인 경험적 실패는 자기 개선이 폐쇄적인 자기 성찰보다는 다양하고 검증 가능한 피드백을 제공하는 외부 소스와의 상호 작용을 필요로 한다는 것을 시사함

본 논문에서는 대규모 문서 코퍼스에서 문맥 정보를 추출하여 문서에 기반한 답변을 제공하는 다양한 추론 과제를 생성하는 자기 플레이 강화 학습 프레임워크인 SPICE(Self-Play In Corpus Environments)를 소개함

단일 모델은 두 가지 역할을 수행

첫째, 도전자(Challenger)로서 이러한 도전적인 문서 기반 과제 커리큘럼을 구성하고, 둘째, 추론자(Reasoner)로서 문서 접근 없이 과제를 해결함으로써 견고한 추론 능력을 개발

핵심 요소는 정보 비대칭성

도전자는 추론자가 볼 수 없는 검색된 문서를 기반으로 질문과 정답을 제시하여 진정한 도전을 만들어냄

방대한 양의 문서는 모델이 내재한 지식을 뛰어넘는 지속적인 새로움을 보장함

동시에, 코퍼스 기반 접근 방식은 질문과 정답을 모델이 생성한 허구가 아닌 실제 세계의 콘텐츠에 근거하게 함으로써, self-play 루프 전반에 걸쳐 사실적 정확성을 보장하여 착각을 방지함

자체 실행(self-play) 과정에서 도전자는 추론자의 능력 한계에 도전하는 문제를 생성하여 성공률의 변동성을 극대화할 때 보상을 받고, 추론자는 정답을 맞힐 때 보상을 받음

이러한 적대적이면서도 상호 보완적인 상호작용과 코퍼스 기반 학습을 통해 시스템은 실제 지식에 기반한 새로운 도전 과제를 지속적으로 발견하고 극복할 수 있음

중요한 점은, 본 접근 방식은 미리 정의된 질문이나 레이블이 없는 원시 문서를 기반으로 한다는 것임

다양한 형식(객관식 질문과 정수/표현식/문자열 답변을 포함하는 자유 형식 질문)으로 생성된 과제는 범용 검증 도구 역할을 하여, 특수 실행기나 규칙 기반 검증기 없이도 모든 언어 영역에서 자체 실행이 가능함

이는 기존 연구를 수학이나 코드와 같은 좁은 영역에 국한시켰던 검증의 병목 현상을 해소하는 동시에, 문서에 근거한 답변을 통해 검증이 사실에 기반하도록 보장함

코퍼스 기반 Self-play 학습은 다양한 모델 선택에 걸쳐 광범위하게 전이되는 추론 능력을 생성함

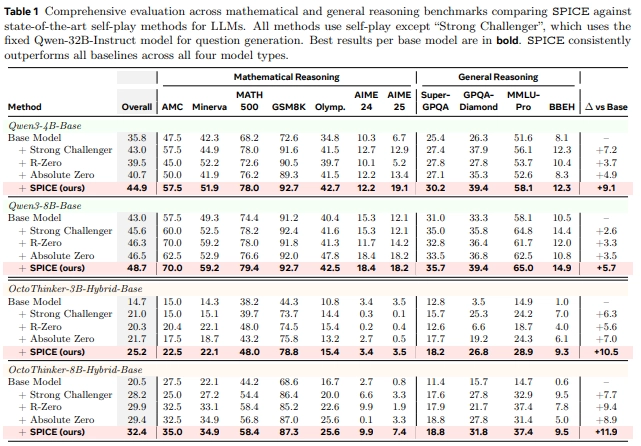

Qwen3-4B-Base 데이터셋에서 SPICE는 기준 성능 35.8% 대비 평균 44.9%의 성능 향상(절대값 +9.1%)을 달성했으며, Qwen3-8B-Base에서는 43.0%에서 48.7%로 향상(+5.7%)함

OctoThinker-3B-Hybrid-Base에서는 14.7%에서 25.2%로 가장 큰 향상(+10.5%)을 보였고, OctoThinker-8B-Hybrid-Base에서는 20.5%에서 32.4%로 향상(+11.9%)하여 SPICE가 표준 RLVR과 순수 RLVR 모두를 능가함

이러한 성과 향상은 수학적 추론(평균 +8.9%)과 일반 추론 과제(MMLU-Pro, GPQA-Diamond, SuperGPQA, BBEH에서 +9.8%) 모두에서 나타나며, 코퍼스 기반 학습이 광범위하게 적용 가능한 능력을 개발한다는 것을 보여줌

도전자와 추론자 간의 대립적 상호작용은 다음과 같이 자동화된 커리큘럼을 생성함:

고정된 추론자의 통과율은 점진적으로 더 어려운 문제를 생성하는 방법을 학습함에 따라 55%에서 35%로 감소하는 반면, 고정된 도전자의 통과율은 55%에서 85%로 증가하여 두 역할의 성공적인 공진화를 보여줌

코퍼스 grounding(기반) 학습은 지속적인 성능 향상에 매우 중요

코퍼스 grounding 학습이 없으면 모델의 성능 향상이 제한적이고 지속적인 학습에 필요한 적응형 과제를 유지하지 못함

코퍼스 grounding 학습을 통해 시스템은 새로운 문서 맥락을 지속적으로 탐색하여 새로운 과제를 해결함으로써 훈련 전반에 걸쳐 안정적인 발전을 유지함

종합적으로, 본 연구는 다음과 같은 기여를 함:

- 대규모 문서 코퍼스를 외부 지식 소스로 취급함으로써 지속적인 자체 개선이 가능하며, 모델의 내재적 지식에만 의존하는 ungrounded 방법보다 우수한 성능을 보임을 입증

- 본 논문에서는 두 가지 역할(도전자와 추론자)을 수행하는 모델이 문서에서 추출한 답을 사용하여 과제를 생성하고 해결하는 코퍼스 grounding(기반)의 Self-Play 방식을 제안. 이 방식은 특수 도구 없이 모든 도메인에서 검증이 가능한 다양한 과제 형식을 사용

- 본 연구에서는 코퍼스 grounding(기반)의 Self-Play 학습이 수학적 추론 및 일반 추론 과제 전반에 걸쳐 일관된 향상을 가져오며, 기존 접근 방식의 영역별 한계를 극복함을 실증적으로 검증함

SPICE는 자기 개선 추론 방식에 있어 패러다임 전환을 제시함

즉, 환각적 표류로 인해 정체되는 경우가 많은 폐쇄 루프 Self-Play 방식에서 벗어나, 웹 문서 코퍼스에 내재된 방대하고 검증 가능한 지식과의 상호작용을 통해 무한히 개선되는 방식을 제안함

SPICE: Self-Play In Corpus Environments

SPICE는 자체 실행을 통해 도전자(C)와 추론자(R)라는 두 가지 역할을 수행하는 단일 모델을 특징으로 하는 엔드투엔드 프레임워크임

도전자 역할을 수행할 때, 모델은 웹 문서를 기반으로 추론자에게 질문을 제시함

이후, 모델은 추론자로 역할을 전환하여 질문에 답함

적대적 역학에 의해 제어되는 이 반복적인 프로세스를 통해 두 역할은 함께 진화하여 점진적으로 더 뛰어난 모델을 구축할 수 있으며, 코퍼스는 지속적인 개선에 필요한 외부 신호를 제공함

전체 프레임워크는 자기 지도 학습 방식으로, 인간의 개입 없이 대규모 비정형 코퍼스만 있으면 됨

그림 2에서 SPICE의 개요를 보여주고, 알고리즘 1에서 학습 방법을 자세히 설명함

다음 하위 섹션에서는 Self-Play 과정에서 각 역할에 대해 간략하게 설명

2.1 Notations and Preliminaries

본 논문에서는 코퍼스 grounding(기반)의 Self-Play를 단일 모델 $\pi_\theta$가 두 가지 역할, 즉 문서에서 질문을 생성하는 역할($\text{role}=C$) 또는 질문에 답하는 역할($\text{role}=R$)을 수행하는 게임으로 수식화

$\mathcal D$를 문서 코퍼스, $\mathcal Q$를 질문 공간, $\mathcal A$를 답변 공간이라고 함

$\text{role}=C$일 때, 모델은 문서 $\mathcal d \sim \mathcal D$에 접근할 수 있고, $\text{role}=R$일 때는 질문 $q\in \mathcal Q$만 볼 수 있어 두 역할 간에 정보 비대칭성이 발생함

2.2 Challenger: Document-Grounded Task Generation

도전자(C) 역할을 수행할 때, 모델 $\pi_\theta$는 추론자에게 최대한 어려운 과제를 제시하면서도 해결 가능한 문제를 생성하는 방법을 학습함

주어진 코퍼스 $\mathcal D$에 대해, $\text{role}=C$인 모델은 다음과 같은 다양한 과제를 생성

(Document Sampling)

저자는 대규모 문서 코퍼스에서 균일하게 구절들을 샘플링하여, 각 부분을 문서 $d\in \mathcal D$로 추출

각 문서는 텍스트에서 직접 추출한 검증 가능한 답변을 가진 질문을 생성하는 데 필요한 맥락을 제공

(Multi-Format Task Generation)

문서 $\mathcal d$가 주어졌을 때, 도전자 모델은 유효한 질문-답변 쌍을 생성하기 위해 여러 번 시도

이 모델은 질문 $q$를 생성하고 문서에서 정답 $a^*$를 직접 추출

$(q,a^{*})\sim\pi_{\theta}(\cdot|d,\text{role}=C)$

챌린저는 문서 평가를 기반으로 두 가지 형식 중 하나를 선택(부록 11 참조):

- 네 가지 선택지와 문서에 근거한 정답이 있는 객관식 문제(MCQ)

- 문서에서 추출한 답을 입력하는 주관식 문제(정수, 수식, 문자열)

생성된 질문 $q$은 형식이 올바르고 생성 과정에서 parsable한 경우 유효한 것으로 간주

부록 11에 자세히 설명된 프롬프트는 도전자가 여러 단계의 복잡한 정보 추출, 난이도 향상 및 self-test를 거치도록 안내하여 질문이 도전적이면서도 원본 문서 없이도 해결 가능하도록 함

(Variance-Based Curriculum Reward)

각 유효한 질문 $(q,a^*)$에 대해 추론자로부터 $K$개의 응답 $\hat a_i$을 샘플링하고, 응답의 스케일링된 분산을 사용하여 도전자의 보상을 계산:

$r_{C}(q,a^{*})=\begin{cases}\exp\left(-\frac{(\text{Var}({l_{1},...,l_{K}})-0.25)^{2}}{2\cdot 0.01}\right)&\text{if }q\text{ is valid}\

\rho&\text{otherwise (penalty)}\end{cases}$

이때 $l_{i}=𝟙[\hat{a}_{i}=a^{*}]$임

이 가우시안 형태의 보상 함수는 [0,1] 범위로 스케일링되며, 분산이 0.25(통과율 50%)일 때 1.0에서 최댓값을 가지며, 이는 최적의 과제 난이도를 나타냄

너무 쉽거나 너무 어려운 작업에는 기하급수적으로 낮은 보상이 주어짐

추론자가 향상됨에 따라 도전자는 작업 난이도를 높이는 것에 대한 보상을 받게 되며, 이는 자동화된 학습 과정을 만들어냄

2.3 Reasoner: Solving Tasks Without Document Access

추론자(R) 역할을 할 때, 모델 $\pi_\theta$는 문서 접근 없이도 도전자의 과제를 해결하는 방법을 학습함

(Answer Generation)

유효한 질문 $q$만 주어지면, 모델은 답변 $\hat a\sim\pi_\theta(\cdot|q,\text{role}=R)$를 생성

모델은 단계별로 추론하고 최종 답변을 $\text{boxed}{}$ 태그 안에 배치하도록 지시받으므로, 오로지 내재된 지식에만 의존하게 됨

(Binary Correctness Reard)

추론기는 규칙 기반 검증기가 문서에서 추출한 정답과 답의 동등성을 확인하는 조건을 만족할 때, 정답 보상 $r_R(\hat a,a^*)=𝟙[\hat{a}_{i}=a^*]$ 을 받음

2.4 Training with Role-Specific Advantages

저자는 기대 보상을 최대화함으로써 두 역할을 공동으로 최적화함(공유 가중치):

$J(\theta)=\mathbb{E}_{d\sim\mathcal{D}}\left[\mathbb{E}_{(q,a^*)\sim\pi_\theta(\cdot|d,\text{role}=C)}[r_{C}(q,a^*)]+\mathbb{E}_{\hat{a}\sim\pi{\theta}(\cdot|q,\text{role}=R)}[r_{R}(\hat{a},a^*)]\right]$

본 연구에서는 각 역할별로 별도의 Advantage 계산을 수행하는 DrGRPO(Liu et al., 2025c)를 사용

분산 보상을 받는 도전자 궤적과 정확성 보상을 받는 추론자 궤적이 주어졌을 때, 역할별 이점을 계산함:

$\hat A^i_C\displaystyle=r_{C}^{i}-\text{mean}({r_{C}^{j}}_{j})$

$\hat A^i_R\displaystyle=r_{R}^{i}-\text{mean}({r_{R}^{j}}_{j})$

표준편차 정규화 없이 역할별 기대치를 중심으로 반환값을 조정함으로써, 저자는 난이도로 인한 잡음이 아닌 진정한 학습 신호를 반영하도록 함

2.5 Implementation

SPICE를 구현하기 위해, LLM(Learning Leadership Model)의 미세 조정을 위한 자체 플레이 강화 학습 시스템을 개발함

저자의 학습 프레임워크는 분산형 Actor-Learner 아키텍처(Espeholt et al., 2018)에 대한 인터페이스를 제공하는 Oat(Liu et al., 2024)를 기반으로 함

→ LLM을 RL로 파인튜닝 하기 위해 Actor(데이터 생성)-Learner(모델 학습) 구조 사용

→ Actor에서는 도전자가 문제 생성, 추론자가 문제 풀이, Learner에서는 그레디언트 계산 및 업데이트

[Actor 1] \

[Actor 2] \ → experience → [Learner] → 모델 업데이트

[Actor 3] /

[Actor N] /도전자 및 추론자 생성 단계 모두에서 효율적인 모델 추론을 위해 vLLM(Kwon et al., 2023)을 사용하여 자체 플레이 루프를 실행하는 액터를 인스턴스화함

→ 실제 실행은 빠른 추론 엔진으로 분산처리

actor들은 역할을 번갈아 수행하며 경험을 생성

먼저 문서에 접근하여 질문을 생성하고(도전자 역할), 그 다음에는 문서에 접근하지 않고 질문에 답함(추론자 역할)

이렇게 생성된 궤적은 같은 장소에 있는 learner에게 전송되고, learner는 DrGRPO를 통해 역할별 이점을 반영하여 LLM을 업데이트함

추론기에서 추출한 응답은 두 가지 목적을 수행

하나는 도전자의 보상에 대한 분산을 계산하는 것이고, 다른 하나는 추론기의 업데이트를 위한 궤적 그룹을 형성하는 것임

저자는 Math-Verify1을 사용하여 답변 검증을 구현했는데, 이는 수학적 표현식에 대한 등가성 검사와 다른 답변 유형에 대한 정확한 일치 검사를 처리

전체 학습 절차는 알고리즘 1에 자세히 설명됨

Experimental Results

3.1 Setup

(Training Configuration)

고품질의 무료 자료에서 가져온 20,000개의 문서로 구성된 코퍼스 $\mathcal D$를 사용

- 수학 영역: Nemotron-CC-Math(Mahabadi et al., 2025)

- 일반 추론 영역에서는 DCLM(Li et al., 2024)의 하위 집합인 NaturalReasoning(Yuan et al., 2025)의 문서를 사용

모델의 컨텍스트 윈도우에 맞도록 최대 5992개의 토큰으로 구성된 문서 세그먼트를 추출

각 반복에서는 문서당 적어도 하나의 유효한 작업$(q,a^*)$을 생성하려고 시도하며, 최대 $N=1024$번의 시도가 이루어짐

유효한 질문이 여러 개 생성될 수 있지만, 도전자(Challenger)와 추론자(Reasoner) 역할 간의 학습 데이터 크기 균형을 맞추기 위해 문서당 하나를 무작위로 선택

두 역할 모두에 대해 temperature 1.0을 사용하며, 질문당 응답 수 $G=8$개의 그룹 크기를 사용

→ 하나의 질문에 8개의 서로 다른 답변 생성

이 그룹은 도전자의 보상에 대한 분산 계산과 DrGRPO Advantage 계산을 위한 그룹 구성이라는 두 가지 목적을 수행

유효하지 않은 질문에 대한 페널티는 $\rho=-0.1$로 설정

저자는 배치 크기 $B=128$로 고정된 $T=640$번의 반복 학습을 수행

모든 방법에 대한 자세한 학습 구성은 부록 8에 제공

(Models and Baselines)

저자는 Qwen3-4B-Base, Qwen3-8B-Base(Yang et al., 2025a), OctoThinker-3B-Hybrid-Base 및 OctoThinker-8B-Hybrid-Base(Wang et al., 2025)의 네 가지 기본 모델에서 SPICE를 평가

저자는 다음과 같은 여러 기준선과 비교:

- Base Model: 사전 학습된 모델로, 사후 학습 없이 초기 성능을 설정

- Strong Challenger: 고정된 더 강력한 모델(Qwen3-32B-Instruct)을 도전자로 사용하여 질문을 생성하고, 저자의 모델은 추론기로만 학습하여 더 강력한 질문 생성기가 학습 성능을 향상시키는지 테스트

- R-Zero(Huang et al., 2025): 문서 접근 없이 모델이 처음부터 자체적으로 질문을 생성하는 순수 코퍼스 기반 Self-Play로, Ungrounded Self-Play를 나타냄

- Absolute Zero(Zhao et al., 2025): 파이썬 실행을 검증 기준으로 사용하는 코드 생성 작업으로 제한된 Self-Play로, 도메인 특화 기반 Self-Play를 나타냄

공정한 비교를 위해 모든 기준선 방법은 공개적으로 사용 가능한 코드를 이용하여 직접 실행했으며, 동일한 학습 인프라, 통합된 평가 프로토콜, 부록 11에 자세히 설명된 모델별 프롬프트 템플릿을 사용

학습 구성은 부록 8에 제공

(Evaluation Benchmarks)

본 연구에서는 수학적 추론 및 일반 추론 과제 전반에 걸쳐 종합적인 평가를 수행

수학적 추론 평가

- 난이도 높은 경시대회 문제 MATH-500(Hendrycks et al., 2021)

- 올림피아드 수준의 문제 OlympiadBench(He et al., 2024)

- STEM 분야 문제 Minerva Math(Lewkowycz et al., 2022)

- 초등학교 수준의 응용 문제 GSM8K(Cobbe et al., 2021)

- 미국 수학 경시대회(AMC, MAA, b), AIME'24, AIME'25(MAA, a)

일반적인 추론 능력을 평가하기 위해

- Google-search-resistant questions를 포함하는 285개 분야의 대학원 수준 추론 대규모 벤치마크인 SuperGPQA(Du et al., 2025)

- 패턴 매칭에 저항하는 대학원 수준 질문으로 구성된 GPQA-Diamond(Rein et al., 2023)

- 까다로운 다중 작업 이해 데이터셋 MMLU-Pro(Wang et al., 2024)

- 더 복잡한 추론 작업을 추가하여 BIG-Bench Hard를 확장한 BBEH(Kazemi et al., 2025)

답변 동등성 검증을 위해 GPT-4o(OpenAI, 2024)를 사용하는 simple-evals2 프레임워크를 사용

대부분의 평가는 Ma et al.(2025)의 방법을 따라 훈련과 일관된 프롬프트를 사용한 탐욕적 디코딩을 사용했으며, AIME'24와 AIME'25는 Zeng et al.(2025)의 방법을 따라 32회 샘플링 실행의 평균값을 사용

자세한 평가 설정은 부록 7에 제공

3.2 Quantative Analysis

표 1은 저자가 사용한 네 가지 기본 모델에 대한 주요 결과를 보여줌

SPICE는 네 가지 모델 계열 모두에서 기준 모델보다 일관되게 우수한 성능을 보였으며, 기본 모델 대비 가장 큰 전반적인 개선을 달성

개선 정도는 각각 +9.1(Qwen3-4B-Base), +5.7(Qwen3-8B-Base), +10.5(OctoThinker-3B-Hybrid-Base), +11.9(OctoThinker-8B-Hybrid-Base)임

수학 및 일반 추론 과제 모두에서 개선이 관찰되었으며, 이는 다양한 문서 코퍼스를 사용하는 것의 이점을 강조함

(Adversarial Learning Dynamics)

그림 3은 도전자와 추론자 기능의 공동 진화를 보여줌

각 역할의 기여도를 분석하기 위해 전체 자체 실행 학습(200~640단계)에서 체크포인트를 추출하고, 128개의 문서 풀(각각 128번의 생성 시도 포함)에서 200단계의 고정 체크포인트와 비교하여 평가함

고정된 단계 수 200의 추론자와 다양한 도전자 체크포인트를 비교 평가했을 때(하위 그래프 a), 도전자 체크포인트가 진행될수록 문제의 난이도가 높아짐에 따라 추론기의 통과율이 55%에서 35%로 감소하는 것을 관찰할 수 있음

반대로, 고정된 단계 수 200의 도전자와 다양한 추론자 체크포인트를 비교 평가했을 때(하위 그래프 b), 후기 체크포인트일수록 문제 해결 능력이 향상됨에 따라 추론기의 통과율이 55%에서 85%로 증가하는 것을 확인할 수 있음

두 역할이 동시에 발전하는 완전한 SPICE 교육에서는 이러한 경쟁적 역학 관계가 어느 한 역할이 단독으로 달성할 수 있는 것 이상의 상호 발전을 이끌어냄

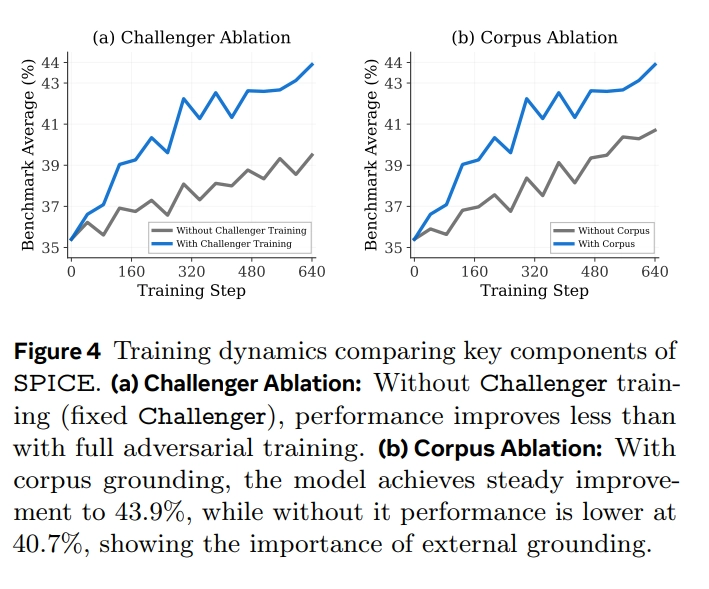

(Challenger Learning Impact)

SPICE의 중요한 구성 요소는 고정된 도전자를 사용하는 대신 추론자와 동시에 도전자를 학습하는 것임

그림 4(a)는 추론기와 함께 도전자를 공동 학습하는 것이 성능 향상을 극대화하는 데 필수적임을 보여주며, 우리의 공진화적 접근 방식을 검증함

챌린저를 학습하지 않으면 추론기는 충분한 도전을 받지 못하여 성능 향상이 더뎌짐

(Corpus Grounding Impact)

마지막으로 SPICE에서 코퍼스 기반 학습의 중요한 역할을 살펴봄

그림 4(b)는 그 결과를 보여줌

코퍼스 기반 학습을 통해, 거의 무한대에 가까운 질문 자료를 제공하는 다양한 문서 맥락에 지속적으로 접근할 수 있어 성능이 43.9%에 도달함

외부 문서에 접근할 수 없는 경우, 모델 성능은 40.7%로 낮아지는데, 이는 코퍼스 기반 학습의 중요성을 보여줌

3.3 Qualitative Analysis

SPICE의 학습 역학을 더 잘 이해하기 위해, 훈련 과정 전반에 걸쳐 도전자와 추론자가 각각 생성하는 작업 및 추론 패턴의 진화를 분석함

(Challenger Task Development)

그림 5는 도전자에게 서로 다른 훈련 단계에서 동일한 문서를 제공했을 때 작업 복잡성이 어떻게 변화하는지 보여줌

초기 작업은 표면적인 정보에 초점을 맞추는 반면, 후기 작업은 심층적인 이해와 다단계 추론을 요구함

초기 단계에서는 추론자가 학습할 수 없기 때문에 도전자가 너무 어려운 작업을 제안할 수 없음

훈련이 진행됨에 따라 도전자는 향상된 추론자의 능력에 맞춰 더 어려운 작업을 생성하는 방법을 학습함

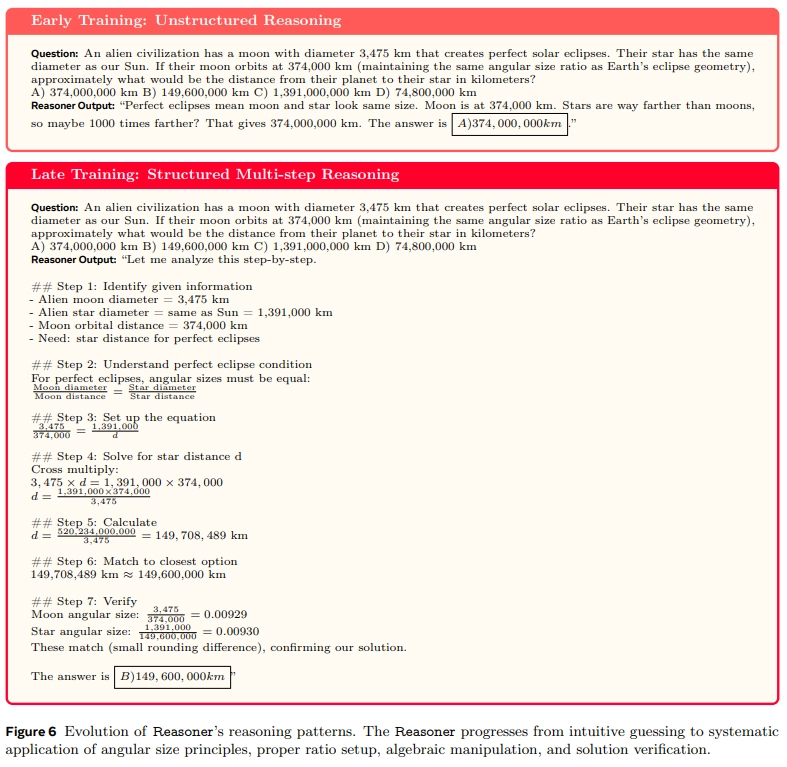

(Reasoner Pattern Development)

그림 6은 서로 다른 훈련 단계에서 동일한 질문에 대해 추론자가 구조화된 문제 해결 접근 방식을 어떻게 발전시켜 나가는지 보여줌

훈련이 진행됨에 따라 점점 더 정교한 추론 패턴이 나타나는데, 이는 추론자가 도전자가 제시하는 점점 더 어려운 과제에 적응해 나가는 과정을 반영함

이러한 발전 과정은 단순한 암기가 아닌 진정한 추론 능력을 보여줌

모델은 문제를 체계적으로 분해하고, 중간 단계를 검증하며, 불일치가 발생할 경우 스스로 수정하는 방법을 학습함

Ablations

SPICE 성능을 좌우하는 핵심 요소를 이해하기 위해 Qwen3-4B-Base 데이터셋에 대한 포괄적인 ablation 연구를 수행

코퍼스 구성, 작업 유형 분포, 도전자 보상 전략이라는 세 가지 중요한 설계 요소를 분석함

모든 실험은 주요 실험과 동일한 학습 구성을 사용함

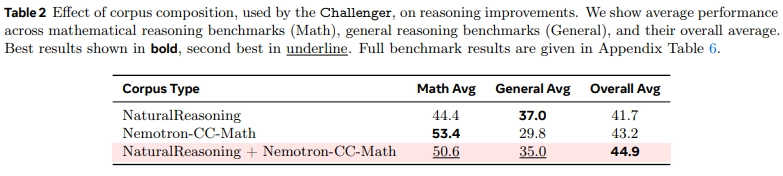

4.1 Corpus Distribution

SPICE의 주요 구성 요소 중 하나는 외부 문서 코퍼스임

코퍼스를 사용하지 않은 순수 ungrounded Self-Play와 비교했을 때, SPICE는 수학 및 일반 추론 작업 모두에서 상당한 성능 향상을 보여줌

본 연구에서는 NaturalReasoning과 Nemotron-CC-Math라는 두 개의 대규모 문서 데이터셋을 사용

문서 유형이 성능에 미치는 영향을 이해하기 위해 각 문서 데이터셋을 개별적으로 분석

표 2에 결과를 제시

예상대로 NaturalReasoning 데이터셋은 일반 추론 작업에 특화된 문서를 포함하고 있기 때문에 일반 추론 작업에서 가장 큰 성능 향상을 보임

마찬가지로 Nemotron-CC-Math 데이터셋은 수학 작업에서 가장 큰 성능 향상을 가져옴

그러나 두 데이터셋을 결합했을 때 전반적으로 가장 우수한 성능을 나타남

4.2 Task Type

SPICE의 두 번째 핵심 기능은 현재 문서에 따라 다양한 유형의 문제를 생성할 수 있다는 점임

SPICE는 객관식(MCQ)과 주관식이라는 두 가지 유형의 문제를 사용

표 3은 객관식 또는 주관식 문제만 사용했을 때와 둘 다 사용했을 때의 결과를 보여줌

주관식 문제만 사용했을 때 수학적 능력이 가장 크게 향상되지만, 객관식과 주관식 문제를 혼합하여 사용했을 때 전반적으로 가장 좋은 성과를 보임

저자는 이러한 현상이 객관식 문제가 신뢰할 수 있는 검증을 제공하는 반면, 주관식 문제는 유연한 추론을 장려하기 때문이라고 생각함

4.3 Challenger’s Reward

마지막으로, 도전자의 보상 함수가 과제 난이도 조정에 결정적인 영향을 미친다는 것을 알 수 있음

추론자와 함께하는 Self-Play에서 도전자가 문제를 선택하는 방식을 결정하는 네 가지 보상 전략을 비교함(보상 시각화는 부록 10, 그림 7 참조)

Absolute Zero 전략에서는 도전자에게 추론자의 평균 성공률을 1에서 뺀 값을 보상으로 제공

즉, 추론자가 더 자주 실패하는 과제일수록 더 높은 보상을 받음

직관적이긴 하지만, 이 작업은 난이도와 학습 가치를 혼동함

→ 그냥 못 푸는 문제를 내도록 학습 될 수 있음

Threshold reward 전략은 Correct rollout 횟수에 따른 이진 신호를 사용함

→ rollout: 하나의 정책(모델)으로 문제를 끝까지 수행해서 얻은 한 번의 실행 결과(trajectory)

⇒ 한 번 풀어본 결과(rollout) → 정답과 일치하면 correct rollout

비교적 해결 가능한 작업에는 보상 1, 통과율이 0% 또는 100%인 작업(불가능하거나 사소한 작업)에는 보상 0을 부여함

R-Zero 보상은 최대 불확실성을 명시적으로 목표로 함

추론자의 여러 응답이 서로 다른 답변으로 고르게 나뉘는 작업에 보상을 제공하며, 가장 일반적인 답변에 정확히 절반이 동의할 때 보상이 최고조에 달함

→ 여러 rollout 응답들 중 가장 많이 나온 특정 답 $a_\text{mode}$의 비율이 0.5(최대 불확실성)일 때 최대 보상

⇒ 정답 맞춘 개수가 아니라 모델 내부에서 가장 유력한 답에 대한 합의 정도

본 연구에서 제시하는 Variance 기반 접근 방식은 유사한 원리를 사용하지만, 단일 모드(답변)와의 일치도를 측정하는 대신 여러 추론기 샘플에 걸쳐 답변 분포의 전체 범위를 포착하여 모델 역량의 최전선에 맞춰 조정된 커리큘럼을 구축함

표 4에 제시된 결과는 SPICE의 분산 기반 보상이 모든 지표에서 최고의 성능을 달성함을 보여줌

여기서 중요한 점은 추론자의 성공률이 균형 잡혀 있을 때 최적의 학습이 이루어진다는 것임