[2026-1] 정유림 - Smarter, Better, Faster, Longer: A Modern Bidirectional Encoder for Fast, Memory Efficient, and Long Context Finetuning and Inference

paper : https://arxiv.org/abs/2412.13663

hugging face : https://huggingface.co/docs/transformers/main/en/model_doc/modernbert

기존 BERT 모델의 한계를 뛰어넘는 ModernBERT를 소개합니다. 2조 개의 토큰으로 학습된 이 모델은 8192 토큰의 긴 시퀀스 길이에서도 뛰어난 성능을 발휘하며, 분류 및 검색 작업에서 최첨단 결과를 달성합니다. 또한, 가장 빠르고 메모리 효율적인 인코더로서 일반적인 GPU에서 효율적인 추론이 가능하도록 설계되었습니다.

1. ModernBERT: 기존 BERT의 한계를 뛰어넘는 혁신적인 인코더 모델

ModernBERT는 2조 개의 토큰으로 학습되어 8192 토큰의 긴 시퀀스 길이에서도 뛰어난 성능을 발휘하며, 분류 및 검색 작업에서 최첨단 결과를 달성하는 가장 빠르고 메모리 효율적인 인코더 모델입니다.

1.1. ModernBERT의 등장 배경 및 필요성

- 기존 BERT 모델의 한계점:

- BERT 출시 이후 획기적인 개선이 부족했습니다.

- 512 토큰으로 제한된 시퀀스 길이, 비효율적인 모델 설계, 제한적인 학습 데이터 등의 단점이 있었습니다.

- Encoder-only 모델의 중요성:

- LLM(Large Language Models)의 인기가 높아짐에도 불구하고, Encoder-only 모델은 여전히 다양한 비생성적 다운스트림 애플리케이션에서 널리 사용됩니다.

- 이유는 적은 추론 요구사항으로 대규모 문서 처리에 효율적이며, 분류 작업에서도 뛰어난 성능을 보이기 때문입니다.

- 특히 정보 검색(IR) 애플리케이션에서 중요한 역할을 하며, 검색 증강 생성(RAG) 파이프라인의 핵심 구성 요소입니다.

- ModernBERT의 필요성:

- 기존 BERT 기반 파이프라인은 오래된 모델에 의존하며, 최신 개선 사항을 활용하지 못하는 단점이 있습니다.

- 따라서 성능, 효율성, 긴 시퀀스 처리 능력을 모두 갖춘 현대적인 Encoder-only 모델이 필요합니다.

1.2. ModernBERT의 핵심 특징 및 기여

- 향상된 아키텍처:

- 표준 트랜스포머 아키텍처에 최신 기술을 통합하여 다운스트림 성능과 효율성을 향상시켰습니다.

- 특히 긴 시퀀스 길이에서의 성능 개선에 중점을 두었습니다.

- 대규모 데이터 학습:

- 2조 개의 토큰으로 학습하여 최신 데이터 규모에 맞춰 모델을 훈련했습니다.

- 코드 데이터를 포함한 다양한 데이터 혼합을 사용하여 모델의 이해력을 높였습니다.

- 최첨단 성능:

- 다양한 분류 및 검색 작업에서 기존 모든 인코더 모델 대비 최첨단 결과를 달성했습니다.

- 효율성:

- 가장 빠르고 메모리 효율적인 인코더로 설계되어 일반적인 GPU에서 효율적인 추론이 가능합니다.

- 8192 토큰 시퀀스를 이전 모델 대비 거의 두 배 빠르게 처리합니다.

- 오픈 소스 공개:

- FlexBERT라는 모듈형 아키텍처 프레임워크와 중간 학습 체크포인트를 공개하여 향후 연구를 지원합니다.

2. ModernBERT의 방법론: 아키텍처 및 학습

ModernBERT는 최신 트랜스포머 아키텍처 개선, 효율성 증대 기법, 하드웨어 최적화 설계를 통해 성능과 효율성을 극대화했습니다.

2.1. 아키텍처 개선

- Bias Terms 비활성화:

- 모든 선형 레이어에서 Bias 항을 비활성화하여 파라미터 예산을 선형 레이어에 더 집중시킵니다.

- 단, 마지막 디코더 선형 레이어는 예외입니다.

- 선형 레이어(계산을 수행하는 핵심 부분)는 보통 가중치(Weight)와 바이어스(Bias) 두 가지로 구성됩니다.

- 가중치(Weight): 데이터의 패턴을 학습하는 주된 부분이에요.

- 바이어스(Bias): 계산 결과에 더해지는 일종의 '고정된 기본값'입니다. 이 기본값 덕분에 모델이 조금 더 유연하게 움직일 수 있지만, 아주 작은 부분이라도 파라미터(예산)를 차지함.

- 선형 레이어(계산을 수행하는 핵심 부분)는 보통 가중치(Weight)와 바이어스(Bias) 두 가지로 구성됩니다.

- Rotary Positional Embeddings (RoPE):

- 절대 위치 임베딩 대신 RoPE를 사용하여 상대적인 거리를 반영하는 방식 사용.

- 효율적인 구현과 컨텍스트 확장의 용이성이 장점입니다.

- Pre-normalization:

- 학습 안정화에 도움이 되는 Pre-normalization 블록을 사용합니다.

- Pre-normalization: ModernBERT는 이 LayerNorm을 계산 블록(어텐션이나 피드포워드 네트워크)을 '통과하기 전'에 적용합니다.

- 장점: 이렇게 하면 학습 과정이 훨씬 되어 모델이 더 잘 수렴(똑똑해지는 과정)할 수 있다고 알려져 있어요.

- AI 모델이 학습할 때, 데이터가 너무 크거나 작으면 계산이 불안정해져서 학습이 엉망이 될 수 있어요. 이를 방지하기 위해 LayerNorm(레이어 정규화)이라는 과정을 거쳐 데이터의 크기를 적절하게 조절해 줍니다.

- 첫 번째 어텐션 레이어의 첫 번째 LayerNorm은 제거하여 반복을 피합니다.

- 기존의 BERT와 같은 표준 트랜스포머 모델들은 주로 Post-normalization 방식을 사용했습니다.

- Post-normalization (계산 후 정규화):

- 데이터가 어텐션 블록이나 MLP 블록(피드포워드)을 통과합니다.

- 그 계산 결과에 LayerNorm을 적용합니다.

- 이후 다음 블록으로 넘어갑니다.

- Post-normalization (계산 후 정규화):

- 기존의 BERT와 같은 표준 트랜스포머 모델들은 주로 Post-normalization 방식을 사용했습니다.

- 핵심 차이:

- BERT: 계산 → 정규화

- ModernBERT: 정규화 → 계산

- 학습 안정화에 도움이 되는 Pre-normalization 블록을 사용합니다.

- GeGLU 활성화 함수:

- 기존 BERT의 GeLU 활성화 함수를 기반으로 하는 GeGLU를 채택하여 경험적 성능 향상을 얻습니다.기존 BERT 모델은 GeLU (Gaussian Error Linear Unit라는 활성화 함수를 사용했습니다.

- 이것은 데이터를 통과시키면서 일정 수준의 비선형성(복잡성)을 부여하여 모델이 복잡한 관계를 학습할 수 있게 해주는 표준적인 방법이었습니다.

- 'Gated(게이티드)'의 의미: 'Gate(문)'이 달렸다는 뜻이에요. 이 밸브(Gate)가 입력된 정보 중 어떤 부분이 다음 단계로 얼마나 많이 통과할지를 동적으로 결정합니다.

- 장점: 최근 연구들에서 GeGLU와 같은 GLU 변형 함수들이 기존 GeLU보다 일관되게 더 나은 경험적 성능 향상을 보여주었기 때문에 ModernBERT에 채택되었습니다.

- ModernBERT는 여기서 한 단계 더 나아가 GeGLU (Gated Linear Units)라는 구조를 기반으로 한 GeGLU를 사용합니다.

- 1. 기존 BERT의 활성화 함수: GeLU

- 기존 BERT의 GeLU 활성화 함수를 기반으로 하는 GeGLU를 채택하여 경험적 성능 향상을 얻습니다.기존 BERT 모델은 GeLU (Gaussian Error Linear Unit라는 활성화 함수를 사용했습니다.

2.2. 효율성 개선

- Alternating Attention:

- 전역 어텐션(Global Attention)과 지역 어텐션(Local Attention)을 번갈아 사용하여 긴 컨텍스트 모델의 효율성을 높입니다.

- 3개 레이어마다 전역 어텐션을 사용하고, 나머지는 128 토큰의 지역 슬라이딩 윈도우 어텐션을 사용합니다.

- 1. 어텐션(Attention)이란?

- 어텐션은 AI가 문장을 처리할 때, "이 단어를 이해하려면 문장 내의 어떤 단어들을 가장 주의 깊게 봐야 할까?"를 결정하는 메커니즘입니다.ModernBERT는 두 가지 다른 어텐션 방식을 섞어 씁니다.

- 2. 두 가지 종류의 어텐션

-

3. 교대(Alternating) 방식의 적용전역 어텐션 (Global Attention) 시퀀스 내의 모든 토큰이 서로에게 주의를 기울입니다. 지역 어텐션 (Local Attention) 토큰들이 작은 범위(128 토큰) 내의 이웃 토큰에게만 주의를 기울입니다. - 3개 레이어마다: 전역 어텐션을 사용해서 전체적인 맥락을 놓치지 않도록 합니다.

- 나머지 레이어: 128 토큰 크기의 지역 슬라이딩 윈도우 어텐션을 사용합니다. 이 방식은 전역 어텐션보다 훨씬 계산량이 적어 메모리와 속도 면에서 효율적입니다.

- ModernBERT는 이 두 가지를 번갈아 가며 사용합니다.

- Unpadding:

- 패딩 토큰을 제거하고 모든 시퀀스를 하나의 배치로 처리하여 계산 낭비를 줄입니다.

- Flash Attention의 가변 길이 어텐션 및 RoPE 구현을 활용하여 효율성을 더욱 높입니다.

- 이를 통해 다른 언패딩 방법 대비 10-20%의 성능 향상을 달성합니다.AI 모델은 보통 여러 개의 문장을 묶어서 한 번에 처리(배치 처리)하는데, 이때 묶이는 문장들의 길이가 다르면 문제가 생깁니다.

- 1. 기존 방식: 패딩(Padding)의 문제점

- 문제: 모델은 모든 문장을 가장 긴 문장에 맞추기 위해 짧은 문장 뒤에 의미 없는 '패딩 토큰(Padding Token)'을 채워 넣습니다.

- 낭비: 이 의미 없는 패딩 토큰들을 처리하는 데 GPU의 귀중한 계산 자원(시간과 메모리)이 낭비됩니다.

- 패딩 제거: 입력받은 데이터에서 이 의미 없는 패딩 토큰들을 모두 제거합니다.

- 하나의 긴 시퀀스로 합치기: 배치에 있던 모든 문장들을 패딩 없이 하나의 긴 시퀀스로 연결합니다.

- 효율적인 처리: 그리고 이 긴 시퀀스를 마치 단 하나의 큰 데이터 덩어리처럼 처리합니다.

- 이 Unpadding을 더 효과적으로 만들기 위해, ModernBERT는 Flash Attention과 RoPE의 최신 구현을 활용하여, 패딩이 없는 상태에서도 어텐션 계산이 정확하고 빠르게 이루어지도록 했습니다.

- ModernBERT는 이 낭비를 없애기 위해 Unpadding을 사용합니다.

- Flash Attention:

- 메모리 및 계산 효율적인 어텐션 커널을 제공하는 Flash Attention을 활용합니다.

- 전역 어텐션에는 Flash Attention 3, 지역 어텐션에는 Flash Attention 2를 사용합니다.

- 전역 어텐션 (Global Attention)에는 Flash Attention 3 사용: 가장 복잡하고 계산량이 많은 전역 계산에는 최신 버전인 FA3를 사용했습니다.

- 지역 어텐션 (Local Attention)에는 Flash Attention 2 사용: 상대적으로 덜 복잡한 지역 계산에는 FA2를 사용했습니다. (FA3가 당시 지역 어텐션을 지원하지 않았기 때문일 수 있습니다.)

- torch.compile:

- PyTorch의 내장 컴파일 기능을 활용하여 학습 효율성을 높이고 처리량을 10% 향상시킵니다.

2.3. 모델 설계

- Deep & Narrow 설계:

- 적은 수의 넓은 레이어보다 많은 수의 좁은 레이어(Hidden size)가 다운스트림 성능에 더 좋다는 연구 결과를 바탕으로 합니다.

- 일반적인 GPU에서 효율적인 추론을 위해 Deep & Narrow 구조를 최대화하면서도 추론 속도 저하를 최소화하도록 설계되었습니다.

- 레이어 및 은닉 크기:

- ModernBERT-base는 22개 레이어, ModernBERT-large는 28개 레이어를 가집니다.

- Base 모델은 은닉 크기 768, Large 모델은 1024를 사용합니다.

- 이러한 비율은 타겟 GPU에서 최적의 타일링을 가능하게 합니다.

2.4. 학습: 데이터 및 설정

- 데이터 혼합:

- 2조 개의 토큰으로 구성된 주로 영어 데이터로 학습했습니다.

- 웹 문서, 코드, 과학 문헌 등 다양한 소스를 포함합니다.

- Tokenizer:

- 기존 BERT 토크나이저 대신 현대적인 BPE 토크나이저를 사용합니다.

- 코드 관련 작업에서 더 나은 토큰 효율성과 성능을 제공합니다.

- 특수 토큰 및 템플릿은 BERT와 동일하게 유지하여 하위 호환성을 보장합니다.토크나이저는 문장을 AI가 이해할 수 있는 작은 단위(토큰)로 쪼개는 도구입니다. 이 쪼개는 방식이 AI의 성능에 큰 영향을 미칩니다.기존 BERT는 WordPiece라는 토크나이저를 사용했습니다.

- 이 방식은 텍스트 데이터에 최적화되어 있었지만, 코드(프로그래밍 언어)와 같은 특수한 데이터를 처리할 때는 효율성이 떨어질 수 있었습니다.

- 장점: 이 새로운 토크나이저는 코드 관련 작업에서 더 나은 토큰 효율성을 보여줍니다. 즉, 코드를 더 간결하고 정확하게 쪼개서 이해할 수 있게 해줍니다.

- 하위 호환성 유지: 중요한 점은, 비록 내부적인 쪼개는 방식은 바뀌었지만, 문장의 시작/끝을 알리는 특수 토큰([CLS], [SEP])이나 템플릿은 기존 BERT와 동일하게 유지했다는 것입니다. 이는 기존에 BERT를 사용하던 시스템과 충돌 없이 바로 적용할 수 있도록 하위 호환성을 보장해 줍니다.

- ModernBERT는 현대적인 BPE(Byte-Pair Encoding) 기반의 토크나이저를 사용합니다. 특히 OLMo 모델의 토크나이저를 수정해서 사용했어요.

- 2. 기존 BERT의 토크나이저 (WordPiece)

- 1. 토크나이저의 역할

- Sequence Packing:

- Unpadding 시 미니 배치 내의 높은 배치 크기 변화를 피하기 위해 Sequence Packing을 사용합니다.

- Sequence Packing은 Unpadding으로 인해 발생한 '학습 묶음 크기의 불규칙성'을 잡아주어 학습을 안정적이고 균일하게 만들어주는 마무리 작업. greedy algorithm을 사용해서 시퀀스를 효율적으로 묶어서, 모든 학습 묶음이 거의 비슷한 양의 실제 데이터를 포함하도록 배치 크기의 균일성을 맞춤.

- 99% 이상의 효율성으로 배치 크기 균일성을 보장합니다.

- Unpadding 시 미니 배치 내의 높은 배치 크기 변화를 피하기 위해 Sequence Packing을 사용합니다.

- 학습 설정:

- Masked Language Modeling (MLM)을 사용하며, Next-Sentence Prediction은 제거했습니다.

- Next-Sentence Prediction 제거: 기존 BERT가 하던 '두 문장이 이어지는지'를 맞추는 훈련은 제거했습니다. 이 방식은 성능 향상에 큰 도움이 되지 않으면서 오버헤드만 늘린다고 판단했기 때문입니다.

- StableAdamW 옵티마이저를 사용하여 학습 안정성을 높였습니다.

- 기존 AdamW보다 더 안정적인 학습을 가능하게 해주는 버전을 사용

- Trapezoidal Learning Rate (LR) 스케줄을 사용하며, 1-sqrt LR decay를 적용합니다.

- 학습률(Learning Rate, 한 번에 얼마나 크게 배울지)을 조절하는 방식입니다. 처음에는 조금씩 올리다가(Warmup), 대부분의 시간 동안 일정하게 유지하고, 마지막에 천천히 낮추는(Decay) 방식을 썼는데, 특히 1-sqrt 감쇠 방식을 사용해 성능을 높임

- 배치 크기 스케줄링을 통해 학습 진행을 가속화합니다.

- 학습 초반에는 작은 묶음으로 시작해서 점차 큰 묶음으로 키워나가며 학습을 진행하여 전체 학습 속도를 가속화

- Masked Language Modeling (MLM)을 사용하며, Next-Sentence Prediction은 제거했습니다.

- 컨텍스트 길이 확장:

- 1024 시퀀스 길이로 학습 후, 전역 어텐션 레이어의 RoPE theta를 160,000으로 높이고 추가 학습을 통해 8192 토큰의 네이티브 컨텍스트 길이를 달성했습니다.

- 단계적 확장: 처음에는 1024 토큰 길이로 학습을 진행했습니다.

- 길이 확장: 이후, 전역 어텐션 레이어의 위치 계산 방식(RoPE theta)을 160,000으로 높이는 특별한 추가 학습을 진행하여 최종적으로 8192 토큰까지 처리할 수 있게 되었습니다.

- 1024 시퀀스 길이로 학습 후, 전역 어텐션 레이어의 RoPE theta를 160,000으로 높이고 추가 학습을 통해 8192 토큰의 네이티브 컨텍스트 길이를 달성했습니다.

3. ModernBERT의 평가: 다양한 작업에서의 성능

ModernBERT는 자연어 이해, 텍스트 검색, 코드 검색 등 다양한 작업에서 기존 모델 대비 뛰어난 성능을 보여주며, 특히 긴 컨텍스트 처리와 효율성 측면에서 두각을 나타냅니다.

3.1. 평가 설정

- 평가 대상:

- ModernBERT-base 및 ModernBERT-large 모델을 평가합니다.

- 비교 대상으로는 BERT-base/large, DeBERTa-v3-base/large, RoBERTa-base/large, NomicBERT, GTE-en-MLM 등 유사한 크기의 기존 인코더 모델을 사용합니다.ModernBERT는 자신의 실력을 증명하기 위해 비슷한 체급의 다른 선수들과 경쟁했습니다.

- ModernBERT-base (약 1억 5천만 개 파라미터)는 BERT-base, RoBERTa-base, DeBERTa-v3-base 등과 경쟁했습니다.

- ModernBERT-large (약 4억 개 파라미터)는 BERT-large, RoBERTa-large, DeBERTa-v3-large 등과 경쟁

- 비교 대상 모델

- 평가 작업:

- 자연어 이해 (NLU): GLUE 벤치마크를 사용합니다.

- 문장의 의미, 감정, 관계 등을 얼마나 잘 파악하는지

- 텍스트 검색 (IR): BEIR 평가 스위트를 사용하며, 단일 벡터(DPR) 및 다중 벡터(ColBERT) 설정을 모두 평가합니다.

- 질문과 가장 관련 있는 문서를 찾아내는 검색 능력

- 긴 컨텍스트 텍스트 검색: MLDR 벤치마크를 사용합니다.

- 아주 긴 문서 속에서 필요한 정보를 찾아내는 지구력 종목

- 코드 검색: CodeSearchNet 및 StackOverflow-QA 벤치마크를 사용합니다.

- 프로그래밍 코드와 관련된 텍스트를 이해하고 검색

- 자연어 이해 (NLU): GLUE 벤치마크를 사용합니다.

3.2. 자연어 이해 (NLU) 성능

- GLUE 벤치마크:

- ModernBERT-base는 DeBERTa-v3-base를 능가하는 최초의 MLM 기반 인코더 모델입니다.

- ModernBERT-large는 GLUE에서 DeBERTa-v3-large에 거의 근접하는 성능을 보이며, 파라미터 수는 1/10 수준입니다.

3.3. 텍스트 검색 (IR) 성능

- 단일 벡터 검색 (DPR):

- BEIR 벤치마크에서 ModernBERT는 DPR 설정에서 기존 인코더 모델보다 우수한 성능을 보입니다.

- 특히 ModernBERT-large는 GTE-en-MLM-large보다 적은 파라미터로 더 높은 성능을 달성합니다.

- 다중 벡터 검색 (ColBERT):

- ColBERT 설정에서도 ModernBERT는 다른 장기 컨텍스트 모델보다 최소 9 nDCG@10 포인트 이상 앞섭니다.

- 이는 긴 컨텍스트 검색 작업에 ColBERT 모델이 적합하다는 것을 보여줍니다.

- 지역 어텐션과 ColBERT 스타일 검색의 시너지 효과가 있을 것으로 추정됩니다.

3.4. 긴 컨텍스트 텍스트 검색 성능

- MLDR 벤치마크:

- 8192 토큰의 네이티브 컨텍스트 길이를 가진 ModernBERT는 MLDR에서 인상적인 성능을 보여줍니다.

- 단기 컨텍스트 모델 및 장기 컨텍스트 NomicBERT보다 우수하지만, GTE-en-MLM보다는 약간 낮은 성능을 보입니다.

- 이는 ModernBERT가 장기 컨텍스트 시퀀스를 효과적으로 처리할 수 있지만, 추가적인 튜닝이 필요할 수 있음을 시사합니다.

3.5. 코드 검색 성능

- CodeSearchNet 및 StackOverflow-QA:

- ModernBERT는 코드 관련 작업에서 모든 다른 모델을 능가합니다.

- 이는 ModernBERT가 프로그래밍 데이터가 포함된 데이터 혼합으로 사전 학습되었기 때문입니다.

- 자연어 텍스트 처리 능력 저하 없이 코드 이해 능력이 향상되었음을 보여줍니다.

4. ModernBERT의 효율성: 속도 및 메모리

ModernBERT는 짧은 컨텍스트와 긴 컨텍스트 모두에서 경쟁 모델 대비 뛰어난 추론 속도와 메모리 효율성을 제공합니다.

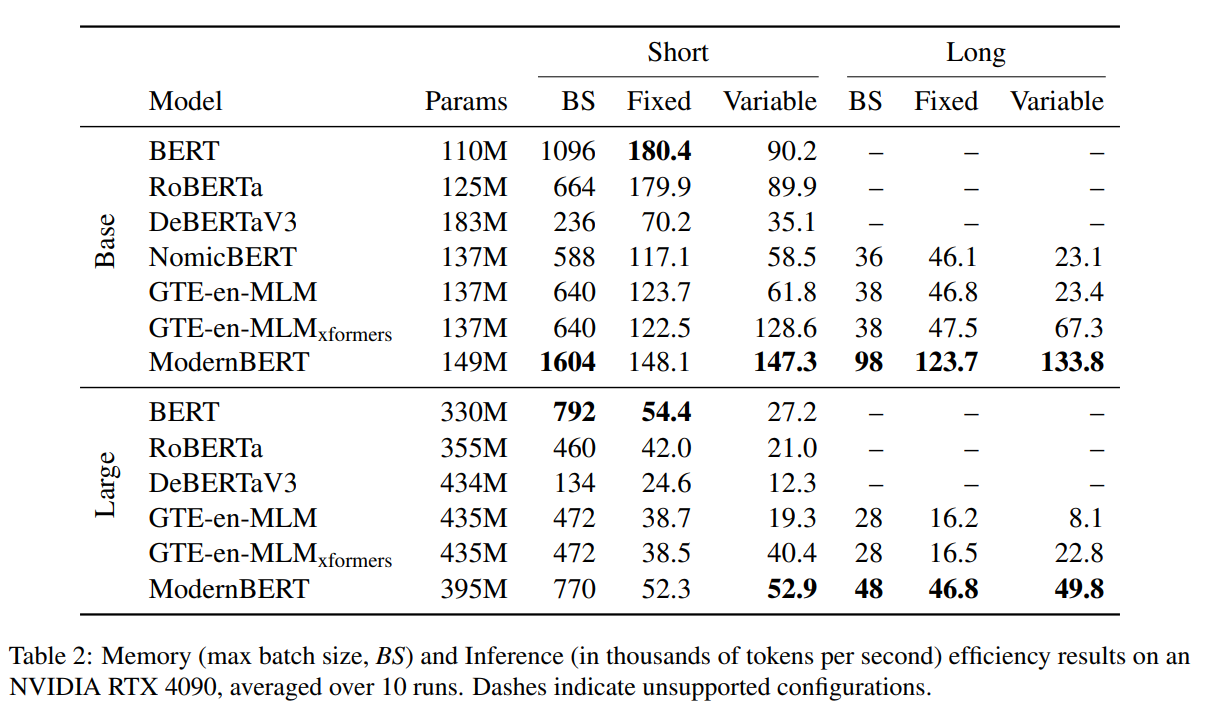

4.1. 평가 설정

- 평가 데이터:

- 다양한 시퀀스 길이를 고려하여 고정 길이 및 가변 길이의 합성 데이터셋을 사용합니다.

- short : 모든 입력 시퀀스의 길이가 512 토큰으로 고정된 데이터셋입니다. (기존 BERT의 최대 길이)

- long : 모든 입력 시퀀스의 길이가 8192 토큰으로 고정된 데이터셋

- BS Fixed (고정 배치 크기) : 배치 내의 모든 시퀀스 길이가 고정되어 있을 때의 성능

- BS Variable (가변 배치 크기) : 배치 내의 시퀀스 길이가 다양하게 섞여 있을 때의 성능

- 결론 : ModernBERT는 특히 가변 길이(Variable) 데이터셋에서 경쟁 모델들보다 훨씬 뛰어난 효율성을 보임.

- 이유: 이는 ModernBERT가 Unpadding 기술을 사용하여 의미 없는 패딩 토큰을 제거하고, Local Attention을 활용하여 가변적인 길이에 유연하게 대처했기 때문

- 다양한 시퀀스 길이를 고려하여 고정 길이 및 가변 길이의 합성 데이터셋을 사용합니다.

- 평가 지표:

- 초당 처리 토큰 수를 기준으로 추론 효율성을 측정합니다.

- 평가 환경:

- 단일 NVIDIA RTX 4090 GPU에서 평가를 수행합니다.

- GTE-en-MLM 모델은 xformers 라이브러리 사용 여부에 따라 두 가지 설정으로 평가합니다.

4.2. 속도 결과

- 전반적인 효율성:

- ModernBERT는 전반적으로 가장 효율적인 모델입니다.

- short 컨텍스트:

- 고정 길이 512 토큰 입력에서 기존 최신 인코더보다 빠르게 처리합니다.

- long 컨텍스트:

- 8192 토큰 길이에서 경쟁 모델 대비 2.65배에서 3배 더 빠르게 처리합니다.

- ModernBERT-large는 GTE-en-MLM-base보다 빠른 속도를 보입니다.

- 가변 길이 입력:

- Unpadding 덕분에 GTE-en-MLM과 함께 가장 빠른 모델 중 하나입니다.

- 지역 어텐션 사용으로 GTE-en-MLM보다 14.5-30.9% 더 효율적입니다.

4.3. 메모리 결과

- 메모리 효율성:

- ModernBERT는 두 모델 크기 모두에서 가장 메모리 효율적인 모델입니다.

- ModernBERT-base는 다른 모든 모델보다 두 배 큰 배치 크기를 처리할 수 있습니다.

- ModernBERT-large는 단기 컨텍스트 입력에서 BERT-large보다 약간 덜 효율적이지만, 다른 대형 모델보다 최소 60% 더 큰 배치를 처리할 수 있습니다.

5. 결론

ModernBERT는 최신 아키텍처와 대규모 데이터 학습을 통해 인코더 모델의 성능과 효율성을 한 단계 끌어올렸으며, 다양한 다운스트림 작업에서 새로운 표준을 제시합니다.